day 24 - recurrent neural networks

(RNN)

day 24 -

recurrent neural networks

(RNN)

السلام عليكم ورحمة الله... معاكم Kaito :)

مرحبا بيكم فالنهار 24 ديال سلسلة 30 يوم من التعلم الآلي..

شفنا ANN

و شفنا CNN

وشفنا البارح NLP

اليوما غنشوفو واحد المفهوم اخر مهم

واللي هو RNN

اختصار لجملة Recurrent Neural Networks

كما راكم ديجا عارفين

الهدف ديالنا من هاد التعلم العميق اللي كنقراو فيه دبا

هو محاولة تقليد الدماغ البشري..

وحنايا شفنا بلي التعلم العميق كيستعمل خوارزميات ديال الشبكات العصبية..

اذن ايلا جينا نشوفو دماغنا والتقسيم ديالو..

ونشوفو كيفاش نربطو كل algorithm شفناه بجزء من الدماغ ديالنا؟

يتكون الدماغ البشري من ثلاثة أجزاء:

المخ cerebrum، وهو اللي جامع كل الأجزاء الملونة ف الصورة اللي التحت،

والمخيخ cerebellum، أو "الدماغ الصغير" اللي مخطط فالتحت..

وجذع الدماغ brainstem، اللي كيربط الدماغ بالأعضاء.

وهاد المخ فيه 4 ديال الفصوص:

-الفص الصدغي temporal lobe،

-الفص الجبهي frontal lobe،

-الفص القذالي occipital lobe،

-الفص الجداري parietal lobe.

الفص الصدغي نقدرو نربطوه بالشبكة العصبية الاصطناعية ANN

نظرا لأنهم كيتافقو فحاجة اساسية… الأوزان the weights

علاش؟

حيتاش ANN يمكن ليها تعلم من خلال

التجارب experiences السابقة اللي عندنا ،

والتكرارات epochs السابقة اللي درنا..

والملاحظات observations السابقة اللي لقينا..

هادشي مهم بزاف..

الأوزان كتمثل الذاكرة طويلة الأمد long-term memory :

ملي كنخدمو ال ANN ديالنا وندربوها،

نقدرو نحبسوها ونعاودو نشعلوها من بعد .. زعما هانية..

حيتاش عندها ذاكرة طويلة الأمد

وبمساعدة دوك الاوزان المعروفة

الشبكة العصبية غادي تعالج المدخلات input

بنفس الطريقة التي كانت دارت البارح

وبنفس الطريقة اللي غتدير غدا وبعدو...

مغديش يتبدل البروسيس..

وبالتالي هاد ANN كتمثل الذاكرة طويلة الأمد ،

وهادي نيت هي خدمة الفص الصدغي ديال الدماغ البشري.

—

الفص القذالي هو منطقة المعالجة البصرية في الدماغ

وايلا تفكرتي معايا شوية..

شكون اللي كيدير التحليل والمعالجة البصرية في التعلم العميق؟

اييه هو هاداك:

Convolutional Neural Networks (CNN)

حيت كيفما شفنا..

هاد CNN هي المسؤولة على مهام التعرف على الصور والأشياء

ودكشي ديال الرؤية الحاسوبية Computer Vision،

قلنا بلي ANN هما الذاكرة طويلة المدى.

هاد RNN كيشبهو الذاكرة قصيرة المدى.

باستعمال RNN كتقدر تعقل على الأشياء اللي عاد طرات ف الملاحظات السابقة

وكتطبق هاد المعرفة ف المستقبل.

بالنسبة لينا حنايا البشر،

هاد الذاكرة قصيرة المدى من الوظائف ديال الفص الجبهي فدماغنا..

وبالتالي غنربطوه مع RNN

—

وبقا لينا الفص الجداري

اللي هو مسؤول على الإحساس والإدراك والشعور

وهو باش كتعرف وكتفهم العالم اللي داير بيك..

هادا مزال مقادو ليه شي بلان ديالو بالذكاء الاصطناعي

(وياربي مايتقادش.. تخيل روبوت كيحس وعندو ادراك ..لا امبوسي)

دخلنا بزاف فعلم الأعصاب

ولكن هانية دبا غنمشيو نشوفو RNN بالرسومات عوتاني..

كيفاش كيتشكل هاد RNN؟

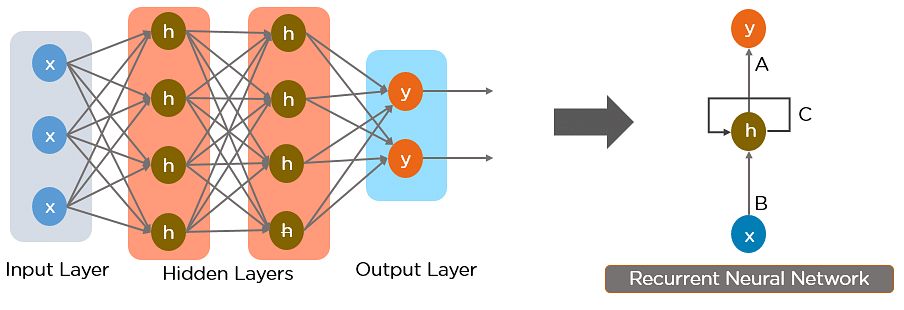

كنبداو بواحد ال ANN بسيطة هي اللي عندنا فهاد الرسم التحت

غادي نحاولو نردوه يولي RNN

وهادشي فيه خطوات

سحق الشبكة Squashing the network

الطبقات راه مامشاو فين

غير بجغنا عليهم وصافي

نتا دير بحتال ايلا كتشوف فالشبكة من الجنب

تغيير الأسهم المتعددة إلى سهمين.

كنقلبو الشبكة باش تولي عمودية

(هاداك هو الشكل اللي خص يكون عند هاد RNN)

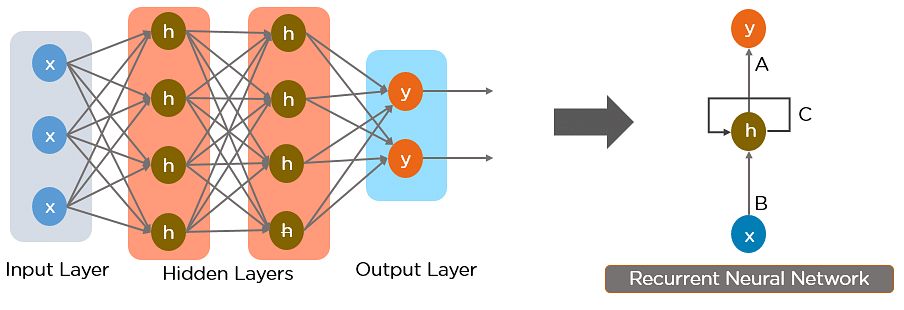

كيتزاد واحد خط كيمثل حلقة زمنية temporal loop.

هذا هو الشكل اللي standard لشبكات RNN

علاش درنا هاد الخط

الخط كيعني بلي هاد الطبقة المخفية اللي الوسط hidden layer

مكتعطيناش مخرجات وصافي,

ولكن دوك المخرجات كتعطيهم لراسها عوتاني كمدخلات..

(كتاكل راسها ان صح التعبير)

من بعد كنحلو ديك الحلقة الزمنية Unfold

وكنقادو RNNs بطريقة جديدة

فالشكل السابق كان كل دائرة كتمثل خلية عصبية وحدة وصافي

ودبا لا.. كل دائرة فالرسم كتمثل طبقة كاملة من الخلايا العصبية.

إذن فالشكل ديالنا عندنا مدخلات وطبقة مخفية ومخرجات كيف العادة،

ولكن تزادت بلي الخلايا العصبية ولات متصلة بنفسها عبر الزمن.

الفكرة اللي جابتها شبكات RNN

هي أن الخلايا العصبية عندها واحد نوع من الذاكرة قصيرة المدى

هادشي كيعطيها إمكانية تذكر شنو اللي كان موجود فديك الخلية سابقًا.

وهكذا كتقدر الخلايا العصبية انها تنقل المعلومات لراسها ف المستقبل وتحليل الأشياء.

بحال ايلا قلتي دبا نيت ونتا كتقرا هاد الايمايل

ايلا مكنتيش عاقل على الفقرة اللي قبل هادي..

مكنظنش غادي تفهم شي حاجة من هادشي اللي كنقول دبا أو دكشي اللي جاي

ولكن ملي كتفكر وكتعقل.. دبا غيبان ليك الضو وغتفهم هدشي اللي كنقول دبا

وهنايا فاش كيجي الدور ديال الشبكات العصبية المتكررة RNNs

واللي هو انك تعطي للحاسوب ديالك واحد الavantage مهم باش يفهمك شكاتقول

وهاد الavantage هي الذاكرة قصيرة المدى..

هادا كان هو RNN باختصار

اللي بغا يفهم اكثر بالتطبيق والارقام تفرج فاحسن فيديو يقدر يشرحو ليك

خلاصة اليوم:

نتلاقاو فايمايل اخر غدا!

كنتمنى تكونو استافدتو.. ايلا عندكم شي تساؤل اولا مشرحتش شي حاجة مزيان، غير صيفط ليا رد فهاد المايل نيت..

— Kaito

ملاحظات:

ايلا عاجبك هدشي وقادر باش تساند هاد newsletter بدعم مادي

دخل لهنا: https://ko-fi.com/callmekaito

شكرا (:

السلام عليكم ورحمة الله... معاكم Kaito :)

مرحبا بيكم فالنهار 24 ديال سلسلة 30 يوم من التعلم الآلي..

شفنا ANN

و شفنا CNN

وشفنا البارح NLP

اليوما غنشوفو واحد المفهوم اخر مهم

واللي هو RNN

اختصار لجملة Recurrent Neural Networks

كما راكم ديجا عارفين

الهدف ديالنا من هاد التعلم العميق اللي كنقراو فيه دبا

هو محاولة تقليد الدماغ البشري..

وحنايا شفنا بلي التعلم العميق كيستعمل خوارزميات ديال الشبكات العصبية..

اذن ايلا جينا نشوفو دماغنا والتقسيم ديالو..

ونشوفو كيفاش نربطو كل algorithm شفناه بجزء من الدماغ ديالنا؟

يتكون الدماغ البشري من ثلاثة أجزاء:

المخ cerebrum، وهو اللي جامع كل الأجزاء الملونة ف الصورة اللي التحت،

والمخيخ cerebellum، أو "الدماغ الصغير" اللي مخطط فالتحت..

وجذع الدماغ brainstem، اللي كيربط الدماغ بالأعضاء.

وهاد المخ فيه 4 ديال الفصوص:

-الفص الصدغي temporal lobe،

-الفص الجبهي frontal lobe،

-الفص القذالي occipital lobe،

-الفص الجداري parietal lobe.

الفص الصدغي نقدرو نربطوه بالشبكة العصبية الاصطناعية ANN

نظرا لأنهم كيتافقو فحاجة اساسية… الأوزان the weights

علاش؟

حيتاش ANN يمكن ليها تعلم من خلال

التجارب experiences السابقة اللي عندنا ،

والتكرارات epochs السابقة اللي درنا..

والملاحظات observations السابقة اللي لقينا..

هادشي مهم بزاف..

الأوزان كتمثل الذاكرة طويلة الأمد long-term memory :

ملي كنخدمو ال ANN ديالنا وندربوها،

نقدرو نحبسوها ونعاودو نشعلوها من بعد .. زعما هانية..

حيتاش عندها ذاكرة طويلة الأمد

وبمساعدة دوك الاوزان المعروفة

الشبكة العصبية غادي تعالج المدخلات input

بنفس الطريقة التي كانت دارت البارح

وبنفس الطريقة اللي غتدير غدا وبعدو...

مغديش يتبدل البروسيس..

وبالتالي هاد ANN كتمثل الذاكرة طويلة الأمد ،

وهادي نيت هي خدمة الفص الصدغي ديال الدماغ البشري.

—

الفص القذالي هو منطقة المعالجة البصرية في الدماغ

وايلا تفكرتي معايا شوية..

شكون اللي كيدير التحليل والمعالجة البصرية في التعلم العميق؟

اييه هو هاداك:

Convolutional Neural Networks (CNN)

حيت كيفما شفنا..

هاد CNN هي المسؤولة على مهام التعرف على الصور والأشياء

ودكشي ديال الرؤية الحاسوبية Computer Vision،

قلنا بلي ANN هما الذاكرة طويلة المدى.

هاد RNN كيشبهو الذاكرة قصيرة المدى.

باستعمال RNN كتقدر تعقل على الأشياء اللي عاد طرات ف الملاحظات السابقة

وكتطبق هاد المعرفة ف المستقبل.

بالنسبة لينا حنايا البشر،

هاد الذاكرة قصيرة المدى من الوظائف ديال الفص الجبهي فدماغنا..

وبالتالي غنربطوه مع RNN

—

وبقا لينا الفص الجداري

اللي هو مسؤول على الإحساس والإدراك والشعور

وهو باش كتعرف وكتفهم العالم اللي داير بيك..

هادا مزال مقادو ليه شي بلان ديالو بالذكاء الاصطناعي

(وياربي مايتقادش.. تخيل روبوت كيحس وعندو ادراك ..لا امبوسي)

دخلنا بزاف فعلم الأعصاب

ولكن هانية دبا غنمشيو نشوفو RNN بالرسومات عوتاني..

كيفاش كيتشكل هاد RNN؟

كنبداو بواحد ال ANN بسيطة هي اللي عندنا فهاد الرسم التحت

غادي نحاولو نردوه يولي RNN

وهادشي فيه خطوات

سحق الشبكة Squashing the network

الطبقات راه مامشاو فين

غير بجغنا عليهم وصافي

نتا دير بحتال ايلا كتشوف فالشبكة من الجنب

تغيير الأسهم المتعددة إلى سهمين.

كنقلبو الشبكة باش تولي عمودية

(هاداك هو الشكل اللي خص يكون عند هاد RNN)

كيتزاد واحد خط كيمثل حلقة زمنية temporal loop.

هذا هو الشكل اللي standard لشبكات RNN

علاش درنا هاد الخط

الخط كيعني بلي هاد الطبقة المخفية اللي الوسط hidden layer

مكتعطيناش مخرجات وصافي,

ولكن دوك المخرجات كتعطيهم لراسها عوتاني كمدخلات..

(كتاكل راسها ان صح التعبير)

من بعد كنحلو ديك الحلقة الزمنية Unfold

وكنقادو RNNs بطريقة جديدة

فالشكل السابق كان كل دائرة كتمثل خلية عصبية وحدة وصافي

ودبا لا.. كل دائرة فالرسم كتمثل طبقة كاملة من الخلايا العصبية.

إذن فالشكل ديالنا عندنا مدخلات وطبقة مخفية ومخرجات كيف العادة،

ولكن تزادت بلي الخلايا العصبية ولات متصلة بنفسها عبر الزمن.

الفكرة اللي جابتها شبكات RNN

هي أن الخلايا العصبية عندها واحد نوع من الذاكرة قصيرة المدى

هادشي كيعطيها إمكانية تذكر شنو اللي كان موجود فديك الخلية سابقًا.

وهكذا كتقدر الخلايا العصبية انها تنقل المعلومات لراسها ف المستقبل وتحليل الأشياء.

بحال ايلا قلتي دبا نيت ونتا كتقرا هاد الايمايل

ايلا مكنتيش عاقل على الفقرة اللي قبل هادي..

مكنظنش غادي تفهم شي حاجة من هادشي اللي كنقول دبا أو دكشي اللي جاي

ولكن ملي كتفكر وكتعقل.. دبا غيبان ليك الضو وغتفهم هدشي اللي كنقول دبا

وهنايا فاش كيجي الدور ديال الشبكات العصبية المتكررة RNNs

واللي هو انك تعطي للحاسوب ديالك واحد الavantage مهم باش يفهمك شكاتقول

وهاد الavantage هي الذاكرة قصيرة المدى..

هادا كان هو RNN باختصار

اللي بغا يفهم اكثر بالتطبيق والارقام تفرج فاحسن فيديو يقدر يشرحو ليك

خلاصة اليوم:

نتلاقاو فايمايل اخر غدا!

كنتمنى تكونو استافدتو.. ايلا عندكم شي تساؤل اولا مشرحتش شي حاجة مزيان، غير صيفط ليا رد فهاد المايل نيت..

— Kaito

ملاحظات:

ايلا عاجبك هدشي وقادر باش تساند هاد newsletter بدعم مادي

دخل لهنا: https://ko-fi.com/callmekaito

شكرا (:

التالي